Nella pratica clinica l’elettrocardiogramma è spesso percepito come un esame standard di routine. Questa visione, tuttavia, riduce l’ECG al suo output finale, la stampa del tracciato, trascurando la complessità tecnica che determina la reale affidabilità diagnostica del segnale.

Il valore clinico di un elettrocardiogramma dipende dalla robustezza dell’intera catena di acquisizione e gestione del segnale. Dalla corretta acquisizione, passando per l’integrità del segnale e la sua elaborazione, fino alla possibilità di confronto longitudinale.

In un contesto in cui le malattie cardiovascolari rappresentano ancora la principale causa di morte globale, la qualità del dato elettrocardiografico diventa un fattore determinante per la diagnosi precoce, la gestione del rischio e l’appropriatezza clinica.

Come funziona davvero un ECG: un segnale piccolissimo per un’informazione ad alta complessità

L’elettrocardiogramma registra differenze di potenziale dell’ordine dei millivolt e microvolt. Questa scala estremamente ridotta rende il segnale intrinsecamente sensibile a interferenze e distorsioni lungo la catena di acquisizione.

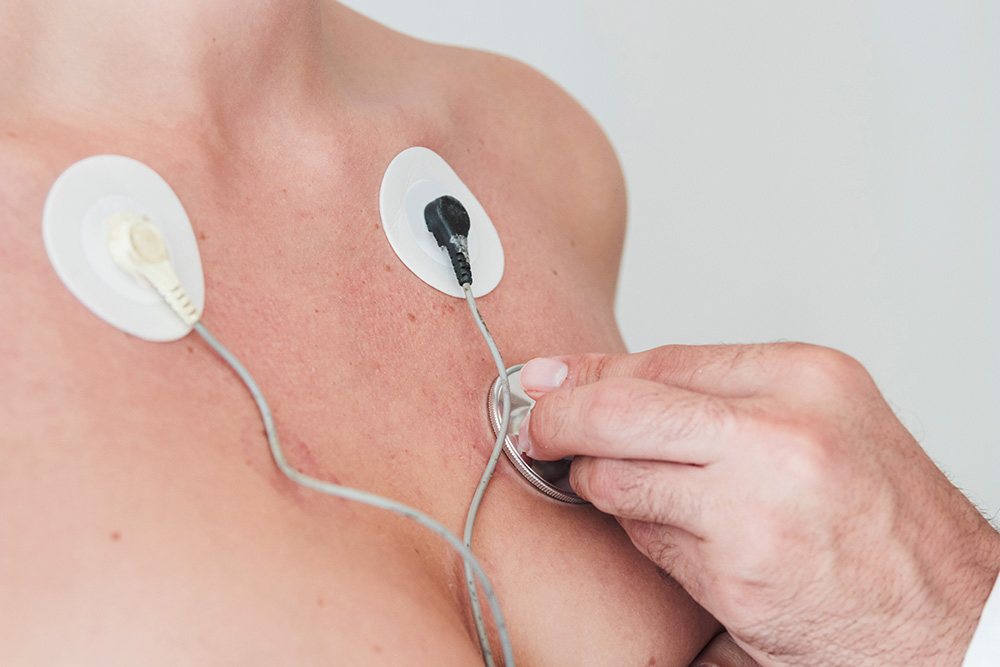

Disturbi ambientali, problemi di contatto elettrodo-cute, errori di posizionamento o scelte di filtraggio non appropriate possono alterare in modo significativo il tracciato, anche in assenza di reale patologia cardiaca.

Prima ancora dell’interpretazione clinica, si pone quindi una questione di affidabilità della misura: quanto è affidabile il segnale ECG registrato?

La qualità del tracciato dipende da:

1. Interfaccia cute-elettrodo. Impedenza di contatto, preparazione della cute, qualità del gel e stabilità dell’elettrodo influenzano direttamente il segnale. Una gestione non ottimale introduce rumore e instabilità della linea di base.

2. Interferenze e rumore elettrico. Il segnale ECG è facilmente alterato da:

- tremore muscolare (EMG)

- rete elettrica

- dispositivi elettromedicali

- movimento del paziente

La gestione di queste interferenze è una componente fondamentale della progettazione dei sistemi ECG.

3. Filtraggio ed elaborazione. I filtri migliorano la leggibilità, ma se troppo aggressivi possono:

- alterare il tratto ST

- distorcere l’onda T

- modificare il complesso QRS

Un tracciato pulito non è sempre un tracciato corretto.

4. Hardware e acquisizione. Parametri come frequenza di campionamento, risoluzione ADC, CMRR e banda passante determinano la qualità reale del segnale.

Quando il problema è l’acquisizione del segnale

Nella pratica clinica quotidiana, una quota non trascurabile di ECG anomali deriva da errori tecnici di acquisizione.

Il tema non è solo riconoscere l’errore, ma prevenirlo, riducendo la variabilità operativa e il rischio di artefatti attraverso standardizzazione dei processi e supporto tecnologico adeguato.

I sistemi ECG possono ridurre significativamente il rischio di errore umano grazie alle funzioni come:

- rilevazione automatica di derivazioni invertite

- controllo della qualità del segnale in tempo reale

- feedback visivi o alert per connessioni non corrette

- acquisizione simultanea e stabile delle 12 derivazioni

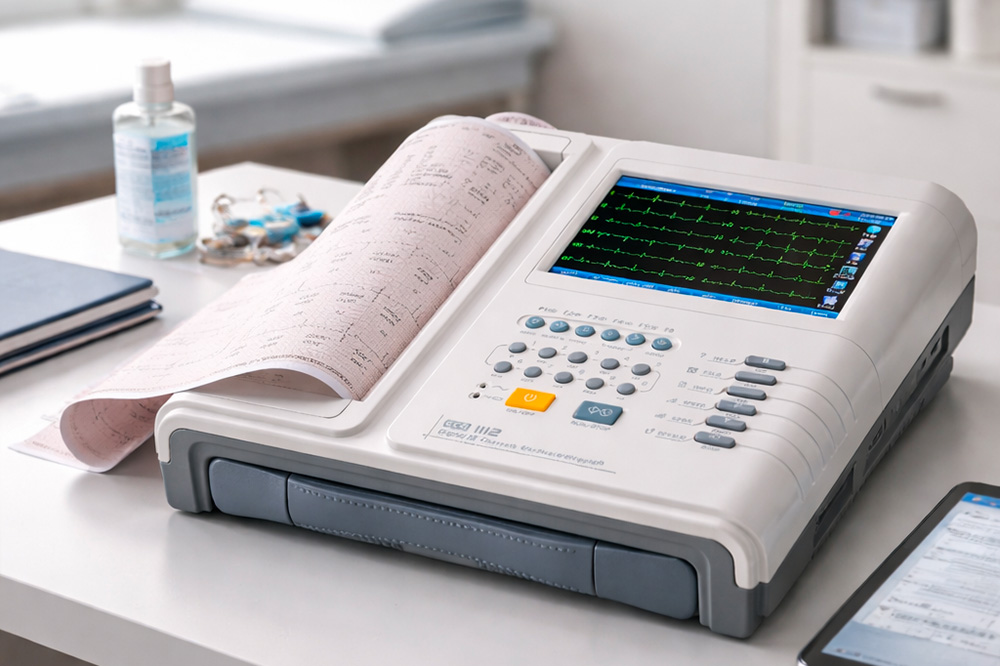

I più evoluti, disponibili in configurazioni da 3,6 o12 canali, integrano queste funzionalità in modo progressivo, adattandosi ai diversi contesti clinici.

Errori di posizionamento degli elettrodi: falsi positivi e pseudo-infarti

Lo scambio di derivazioni, sia negli arti che nelle derivazioni precordiali, può generare pattern ECG che simulano condizioni patologiche rilevanti:

- infarto miocardico

- deviazioni dell’asse elettrico

- ritmi ectopici

Database clinici come LITFL (Life in the Fast Lane) documentano numerosi casi di pseudo-infarto dovuti esclusivamente a errori di collegamento degli elettrodi.

Studi su contesti clinici reali indicano che circa l’1,5% degli ECG presenta errori di posizionamento delle derivazioni1. Se proiettiamo questa percentuale su un grande ospedale, questo dato si traduce in un numero significativo di potenziali errori diagnostici evitabili.

Perché la qualità tecnica dell’ECG è una priorità clinica

La qualità del segnale elettrocardiografico non è un dettaglio tecnico, ma una variabile che impatta direttamente sull’intero processo diagnostico e terapeutico. Un ECG tecnicamente affidabile influisce direttamente su:

- Appropriatezza diagnostica: riduce il ricorso a esami di secondo livello (ecocardiogrammi, test da sforzo, coronarografie diagnostiche) e ricoveri non necessari.

- Riduzione del time-to-therapy: in contesti di emergenza, la qualità del tracciato influisce direttamente sulla rapidità delle decisioni cliniche.

- Qualità del follow-up: il valore dell’ECG nel tempo dipende dalla possibilità di effettuare confronti longitudinali coerenti.

Per garantire questi standard, il segnale deve essere stabile, pulito e privo di artefatti rilevanti. I sistemi ECG avanzati integrano algoritmi di Signal Quality Assessment (SQA) che permettono di analizzare la stabilità del segnale in tempo reale, identificare anomalie di acquisizione e classificare il tracciato come accettabile o non accettabile.

Questo tipo di supporto riduce la dipendenza dall’esperienza dell’operatore e migliora la standardizzazione.

L’ECG oggi: da istantanea a dato longitudinale

Tradizionalmente l’elettrocardiogramma rappresenta una “fotografia” dello stato elettrico del cuore in un preciso momento. Il suo valore clinico cresce quando viene inserito in una logica di monitoraggio comparativo, permettendo di confrontare i dati nel tempo.

Questo approccio richiede coerenza lungo tutta la catena di acquisizione: stessa tecnica, stessa configurazione delle derivazioni, archiviazione strutturata e possibilità di analisi dei trend.

Fondamentale nel supporto clinico per:

- monitoraggio di aritmie cardiache

- evoluzione dei disturbi di conduzione

- follow-up ischemico

- screening e intercettazione delle aritmie silenti

Il monitoraggio della fibrillazione atriale consente di identificare episodi aritmici anche silenti e di avviare tempestivamente strategie terapeutiche che riducono il rischio di ictus.

Sintetizzando il cambio di paradigma: l’ECG non è un’immagine, ma un dato. E un dato ha valore solo se è riproducibile e confrontabile.

Integrazione con nuove tecnologie: opportunità e limiti

Oggi l’integrazione tra dispositivi professionali e nuove frontiere tecnologiche (wearable, patch ECG) sta ampliando la capacità di monitoraggio continuo.

Lo studi Apple Heart Study (NEJM) ha dimostrato come algoritmi di notifica possano identificare anomalie del ritmo2. Tuttavia, emergono anche alcune criticità:

- disponibilità limitata di dati ECG completi (spesso monocanale)

- necessità di conferma con metodiche standard

- possibile generazione di falsi positivi, con impatto sui percorsi clinici

Per questo motivo, tali tecnologie possono essere utili per l’identificazione precoce di episodi aritmici, ma è fondamentale distinguere tra screening e diagnosi.

Le linee guida ESC sottolineano l’importanza dello screening opportunistico della fibrillazione atriale (FA), ma ribadiscono anche che la conferma diagnostica richiede sempre un tracciato ECG standard di qualità clinica3.

Queste tecnologie devono quindi essere inquadrate come strumenti di supporto al triage.

Come valutare un sistema ECG: tre domande chiave

Per chi deve selezionare tecnologia elettrocardiografica, la valutazione non dovrebbe limitarsi alla funzionalità di base. È più utile ragionare in termini di qualità del dato e riduzione del rischio operativo.

Tre domande possono guidare la scelta:

- Il dispositivo garantisce tracciati stabili e puliti anche in condizioni non ideali?

- Il sistema consente un’archiviazione strutturata e un confronto affidabile con esami precedenti?

- Il software supporta l’operatore nella riduzione della variabilità e del rischio di errore umano?

Il valore diagnostico dell’ECG dipende dalla qualità del segnale

Ridurre l’elettrocardiogramma a un output di stampa significa perdere di vista il suo reale valore clinico.

Un ECG è il risultato di un processo di misura complesso, in cui ogni fase contribuisce all’affidabilità della diagnosi. In questo contesto, la scelta della tecnologia e la standardizzazione dei processi sono fattori determinanti per:

- accuratezza diagnostica

- gestione del rischio clinico

- continuità e confrontabilità del dato nel tempo

In assenza di questi requisiti, anche il tracciato apparentemente più “leggibile” può risultare fuorviante.

Nella selezione di un elettrocardiografo, questi elementi si traducono in scelte tecnologiche concrete: numero di canali, qualità del segnale, sistemi di controllo automatico e capacità di integrazione con i flussi clinici.

In ultima analisi, la qualità della diagnosi è direttamente proporzionale alla solidità del segnale su cui si basa.

Fonti

1 A Study of the Frequency of Lead Reversal at a Tertiary Care Institution. Cureus, 2025

2 Large-Scale Assessment of a Smartwatch to Identify Atrial Fibrillation. NEJM, 2019

3 ESC Guidelines for the diagnosis and management of atrial fibrillation